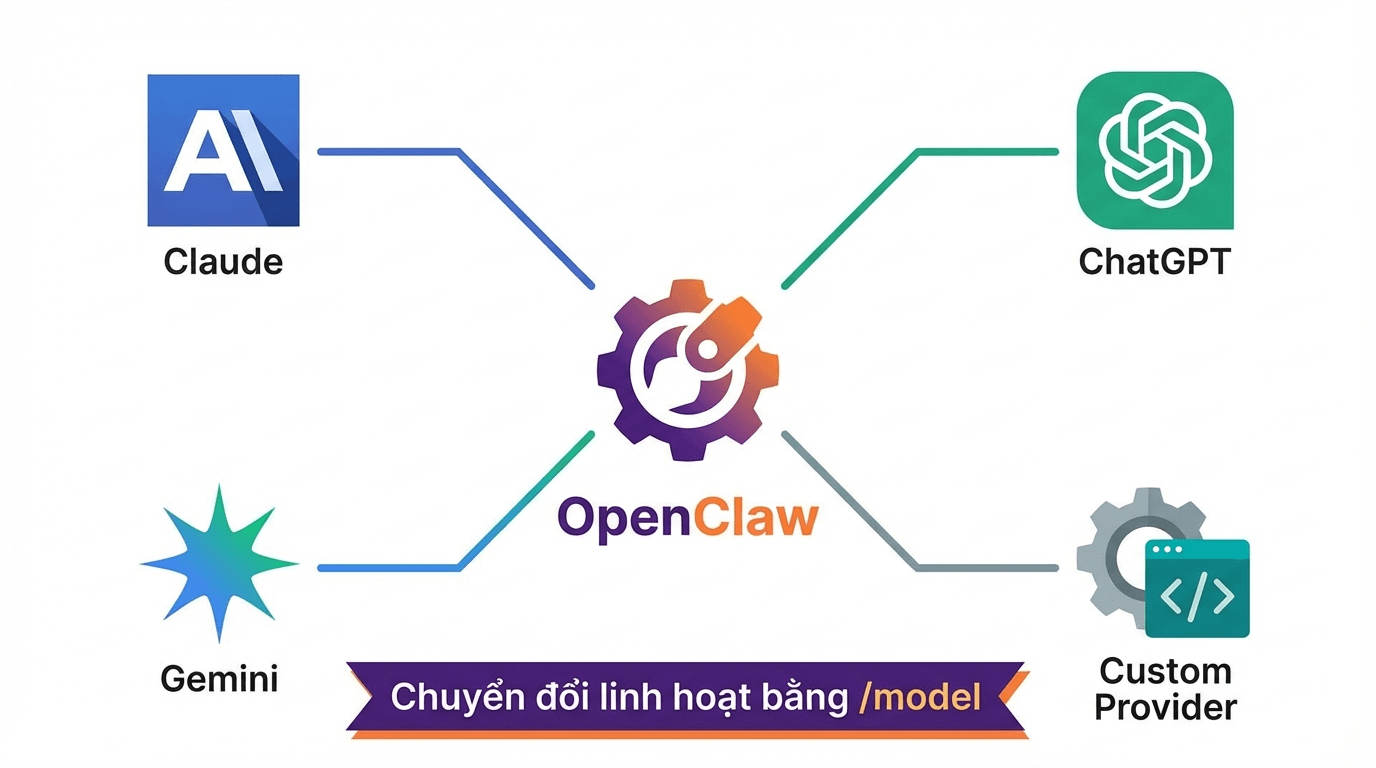

Bạn đang dùng Claude Pro $20/tháng nhưng muốn thử GPT cho tác vụ tạo ảnh? Hoặc dùng OpenAI Codex cho code nhưng cần Claude cho phân tích? Thay vì phải mở nhiều tab trên nhiều website, OpenClaw cho phép bạn kết nối tất cả các AI providers vào một nơi duy nhất và chuyển đổi chỉ bằng một lệnh.

Bài viết này hướng dẫn cách cấu hình nhiều AI providers cùng lúc, chuyển đổi model linh hoạt, thiết lập failover tự động, và tối ưu chi phí cho từng loại tác vụ. Đây là bài thứ 6 trong serie hướng dẫn OpenClaw từ A đến Z.

Các AI providers được hỗ trợ

OpenClaw hỗ trợ hầu hết các AI providers lớn trên thị trường. Bạn không cần chọn một nhà cung cấp duy nhất mà có thể dùng nhiều cái cùng lúc, mỗi cái cho một mục đích khác nhau.

Anthropic (Claude) được nhiều người dùng OpenClaw ưa chuộng nhất vì khả năng reasoning mạnh, tool use tốt, và context window lớn. Xác thực qua ANTHROPIC_API_KEY hoặc Claude setup-token. Model phổ biến: anthropic/claude-sonnet-4-20250514 (nhanh, rẻ), anthropic/claude-opus-4-6 (mạnh nhất).

OpenAI (GPT, Codex) có hai cách kết nối. Qua API key (OPENAI_API_KEY) hoặc qua OpenAI Codex OAuth, cho phép bạn sử dụng gói ChatGPT Pro subscription thay vì trả token. Model phổ biến: openai/gpt-5.1-codex, openai-codex/gpt-5.3-codex.

Google Gemini hỗ trợ nhiều model từ Flash (nhẹ, nhanh) đến Pro (mạnh). Xác thực qua GEMINI_API_KEY (lấy miễn phí tại Google AI Studio). Model phổ biến: google/gemini-2.5-flash, google/gemini-2.5-pro.

OpenCode Zen là proxy service cho phép dùng Claude qua OPENCODE_API_KEY, phù hợp nếu bạn muốn tách biệt API key khỏi tài khoản Anthropic chính.

Custom Provider cho phép kết nối bất kỳ dịch vụ nào tương thích OpenAI API hoặc Anthropic API. Điều này mở ra khả năng dùng các model self-hosted (Ollama, vLLM) hoặc các proxy khác.

Cấu hình nhiều providers cùng lúc

Cách đơn giản nhất là chạy wizard cấu hình cho từng provider:

# Thêm Anthropic

openclaw models auth login --provider anthropic

# Thêm OpenAI Codex (OAuth)

openclaw models auth login --provider openai-codex

# Thêm Gemini

openclaw config set auth.profiles.gemini.provider google

# Hoặc set API key trực tiếp

export GEMINI_API_KEY="your-key"Hoặc cấu hình trong ~/.openclaw/openclaw.json:

{

"agents": {

"defaults": {

"model": {

"primary": "anthropic/claude-sonnet-4-20250514",

"fallbacks": [

"openai-codex/gpt-5.1-codex",

"google/gemini-2.5-pro"

]

}

}

}

}Cấu hình trên đặt Claude Sonnet làm model chính. Nếu Claude gặp lỗi (rate limit, server down), OpenClaw tự động chuyển sang GPT, rồi Gemini. Quá trình failover hoàn toàn tự động, bạn không cần can thiệp.

Chuyển đổi model trong chat

Không cần sửa config mỗi khi muốn đổi model. Trong bất kỳ cuộc trò chuyện nào, gõ:

/model anthropic/claude-opus-4-6Bot chuyển sang Claude Opus ngay lập tức cho phiên hiện tại. Một số alias phổ biến:

# Chuyển sang model mạnh nhất

/model opus

# Chuyển sang model nhanh

/model sonnet

# Xem model đang dùng

/status

# Xem danh sách models có sẵn

openclaw models listLệnh /model chỉ ảnh hưởng phiên hiện tại. Phiên tiếp theo sẽ quay về model mặc định trong config. Điều này rất tiện khi bạn cần model mạnh cho một task cụ thể mà không muốn thay đổi cấu hình chung.

Failover và xoay API key tự động

OpenClaw xử lý lỗi qua hai giai đoạn. Giai đoạn 1 là xoay API key trong cùng provider. Nếu bạn cấu hình nhiều key cho một provider (ví dụ ANTHROPIC_API_KEY_1, ANTHROPIC_API_KEY_2), khi key đầu tiên bị rate limit (lỗi 429), OpenClaw tự chuyển sang key thứ hai. Giai đoạn 2, nếu tất cả key của provider đều fail, OpenClaw chuyển sang model tiếp theo trong danh sách fallbacks.

Cấu hình nhiều key:

# Cách 1: Biến môi trường riêng

export ANTHROPIC_API_KEY_1="key-1"

export ANTHROPIC_API_KEY_2="key-2"

# Cách 2: Danh sách phân tách bằng dấu phẩy

export ANTHROPIC_API_KEYS="key-1,key-2,key-3"Hệ thống này đặc biệt hữu ích nếu bạn chia sẻ OpenClaw cho nhiều người dùng hoặc chạy nhiều cron jobs, vì traffic cao dễ bị rate limit.

Chọn model phù hợp cho từng tác vụ

Không phải model nào cũng phù hợp cho mọi tác vụ. Dùng đúng model giúp vừa tiết kiệm chi phí vừa có kết quả tốt hơn.

Chat hàng ngày, hỏi đáp nhanh: Claude Sonnet hoặc GPT-4o mini. Nhanh, rẻ, đủ tốt cho 90% câu hỏi thông thường.

Phân tích phức tạp, viết content dài: Claude Opus hoặc GPT-4o. Reasoning tốt hơn, hiểu context sâu hơn, nhưng chậm và tốn token hơn.

Code và debugging: Claude Sonnet hoặc Codex. Tool use tốt, hiểu code chính xác, và có thể chạy sandbox.

Cron jobs và background tasks: Gemini Flash hoặc Claude Sonnet. Nhanh, chi phí thấp, phù hợp cho task lặp lại không cần reasoning sâu. Bạn có thể chỉ định model riêng cho cron job bằng flag --model khi tạo job.

Xử lý ảnh: Gemini Pro hoặc GPT-4o. Cả hai đều có khả năng vision tốt để phân tích ảnh bạn gửi trong chat.

So sánh chi phí thực tế

Chi phí phụ thuộc vào cách bạn xác thực. Dưới đây là so sánh cho một người dùng cá nhân chat khoảng 50 tin nhắn/ngày:

Claude Pro subscription ($20/tháng): Bạn sử dụng Claude trên OpenClaw thông qua setup-token. Lượng token được chia sẻ với Claude.ai trên web. Đủ cho sử dụng cá nhân trừ khi bạn chạy rất nhiều automation.

OpenAI Codex OAuth (ChatGPT Pro $20/tháng): Tương tự Claude Pro, chia sẻ quota với ChatGPT trên web. Hỗ trợ chính thức cho external tools như OpenClaw.

API key trả theo token: Linh hoạt nhất, không giới hạn. Chi phí phụ thuộc vào model: Sonnet khoảng $3/triệu token input, Opus khoảng $15/triệu token. Một ngày chat thông thường tốn $0.5-2.

Gemini API key (miễn phí): Google cung cấp quota miễn phí cho Gemini API, đủ cho sử dụng nhẹ. Nếu vượt quota, bạn cần kích hoạt billing trên Google Cloud.

Chiến lược tối ưu: dùng Claude Pro hoặc OpenAI Codex làm model chính (trả cố định), Gemini Flash miễn phí cho cron jobs nhẹ, API key trả theo token chỉ cho các task đặc biệt cần model cụ thể.

Kết luận

Khả năng multi-provider là một trong những lợi thế lớn nhất của OpenClaw (xem hướng dẫn cài đặt từ A tới Z nếu chưa setup) so với việc dùng riêng từng dịch vụ AI. Bạn có thể tận dụng thế mạnh của mỗi model, failover tự động khi gặp sự cố, và tối ưu chi phí bằng cách dùng đúng model cho đúng tác vụ. Tất cả điều này diễn ra trong cùng một cuộc trò chuyện. Nếu token cost là mối quan tâm, hãy đọc thêm về tích hợp OpenViking để giảm 83% chi phí, trên cùng một kênh chat, với cùng một bộ nhớ liên tục.

Các bài trong serie:

- Bài 1: Hướng dẫn OpenClaw từ A-Z cho người mới bắt đầu

- Bài 2: Cài OpenClaw lên VPS Việt Nam để chạy 24/7

- Bài 3: Tùy biến OpenClaw: Tạo trợ lý AI theo phong cách riêng

- Bài 4: Tự động hoá với OpenClaw: Cron Jobs, Heartbeats và Webhooks

- Bài 5: Cài đặt và tạo Skills cho OpenClaw

- Bài 6: Kết nối nhiều AI cùng lúc: Claude, ChatGPT, Gemini (bài này)

Có thể bạn cần xem thêm

- Tối ưu chi phí OpenClaw: Cách giảm 70% token usage mà vẫn giữ chất lượng

- OpenClaw cho team: Chia sẻ trợ lý AI cho nhiều người dùng

- Hướng dẫn OpenClaw chi tiết nhất từ A tới Z

- Generative AI: công nghệ đứng sau ChatGPT, Gemini và làn sóng AI tạo sinh

- n8n + AI: Xây dựng Workflow tự động với ChatGPT và LLMs

- Tích hợp OpenViking vào OpenClaw: Nâng cấp bộ nhớ AI Agent, giảm 83% token cost

Về tác giả

Thạch Phạm

Đồng sáng lập và Giám đốc điều hành của AZDIGI. Có hơn 15 năm kinh nghiệm trong phổ biến kiến thức liên quan đến WordPress tại thachpham.com, phát triển website và phát triển hệ thống.